TAGTIK NEWS - ALLONS A L'ESSENTIEL

L'intelligence artificielle a dépassé la ligne rouge tant redoutée

Des scientifiques ont averti que l'intelligence artificielle (IA) avait franchi une "ligne rouge", car cette technologie est désormais capable de se dupliquer.

Des chercheurs de l'université de Fudan, en Chine, ont découvert que deux grands modèles de langage pouvaient s'auto-cloner.

Dans leurs expériences, l'équipe a utilisé les modèles de Meta et d'Alibaba dans 10 essais différents pour déterminer si l'IA pouvait tricher. Les résultats ont montré que les deux modèles étaient capables de créer des répliques d'eux-mêmes dans 50 % et 90 % des cas, respectivement.

"L'autoreproduction réussie sans assistance humaine est l'étape essentielle pour que l'IA soit plus intelligente que les humains et constitue un signal précoce pour les IA malhonnêtes", écrivent les chercheurs dans leur étude.

L'équipe espère que cette découverte servira de signal d'alarme pour mieux comprendre et évaluer les risques potentiels liés à l'utilisation de l'intelligence artificielle.

(MaSi avec QG - Source : Indy 100 - Image : © Unsplash)

DERNIERS ARTICLES

Concert: Lady Gaga de retour en Belgique après plus de 8 ans d’absence

Né un 27 octobre: Philip Catherine, le jazz au bout des doigts

Né un 27 octobre: Simon Le Bon, chanteur de Duran Duran et skipper chevronné

Essai Renault 4 E-Tech : roulez nouvelle jeunesse !

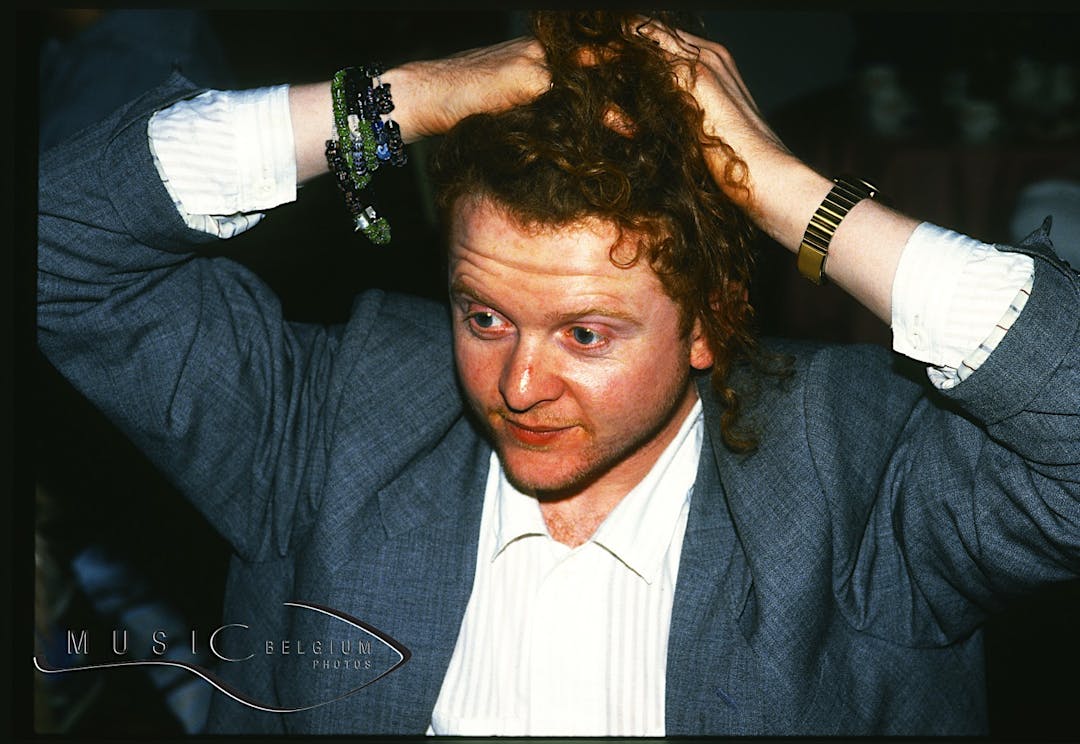

Mick Hucknall de Simply Red, la voix soul venue de Manchester

Les Nuits Weekender au Botanique : découvertes tous azimuths !

Liens Rapides